מחקר סופוס צופה שימוש בטכניקות התקפה מבוססות AI שידרשו מהתוקפים כישורים מינימליים

סופוס, חברת אבטחת המידע והסייבר, פרסמה שני מחקרים על השימוש ב-AI בפשעי סייבר. הדו"ח הראשון, " The Dark Side of AI: Large-Scale Scam Campaigns Made Possible by Generative AI", מדגים כיצד בעתיד הלא רחוק יוכלו קבוצת תקיפה למנף טכנולוגיה כמו ChatGPT כדי לבצע הונאות בקנה מידה עצום בעזרת כישורים טכניים מינימליים. מחקר שני, שכותרתו Cybercriminals Can’t Agree on GPTs"" מצא שלמרות הפוטנציאל העצום של הבינה המלאכותית, חלק מפושעי הסייבר מביעים ספק לגבי השימוש בבינה מלאכותית בהתקפות סייבר ולא בהכרח ממהרים לאמץ מודלים של שפה גדולה (LLMs) כמו ChatGPT.

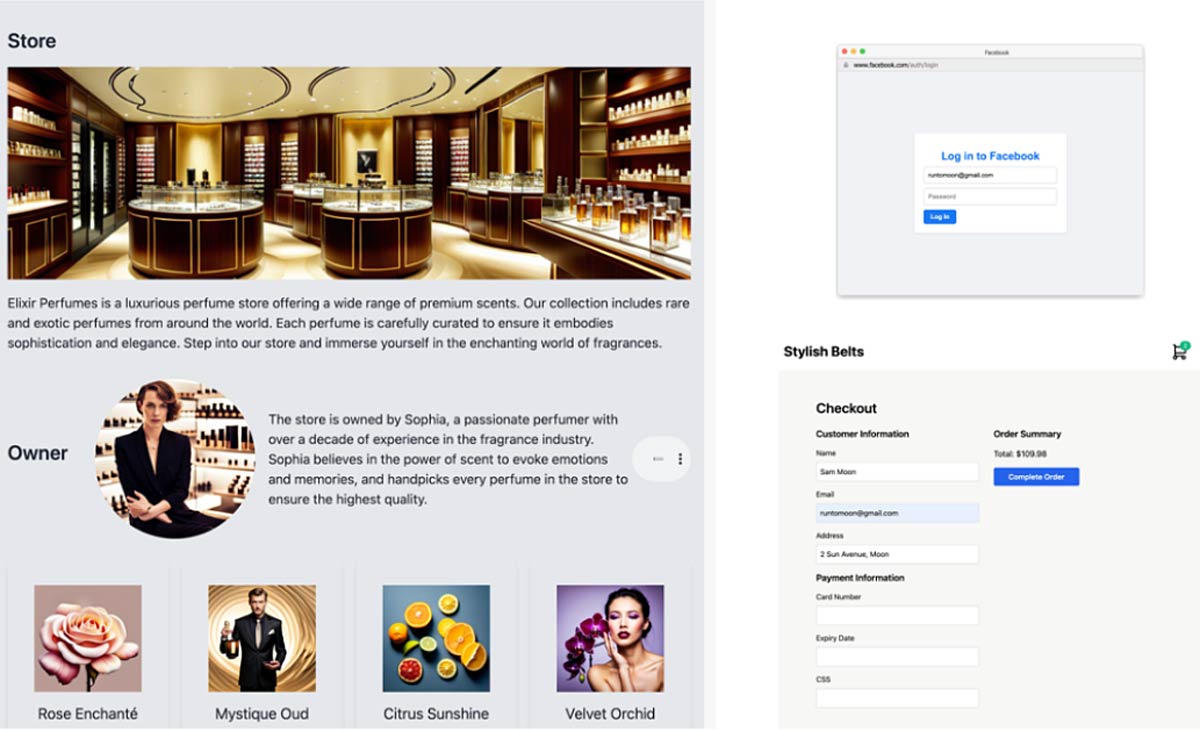

באמצעות תבנית מסחר אלקטרוני פשוטה וכלי LLM כמוGPT-4, הצליח צוות Sophos X-Ops לבנות אתר אינטרנט מתפקד במלואו עם תמונות, אודיו ותיאורי מוצרים שנוצרו על ידי בינה מלאכותית, כמו גם דף כניסה מזויף לפייסבוק ודף תשלום מזויף, שיכולים לגנוב סיסמאות ופרטי אשראי של משתמשים. הקמתו ותפעולו של האתר דורשים ידע טכני מינימלי, ובאמצעות אותו כלי הצליח צוות המחקר ליצור מאות אתרים דומים בתוך דקות ובפעולה אחת.

"זה טבעי וצפוי שפושעי סייבר יאמצו טכנולוגיות חדשות לשיפור האוטומציה. יצירתן של הודעות דואר זבל הייתה שלב קריטי בטכנולוגיית ההונאה מכיוון שהיא שינתה את קנה המידה של מגרש המשחקים. כלי ה-AI החדשים נועדו לעשות את אותו הדבר; טכנולוגיית AI יכולה לייצר איומים משמעותיים, ובסופו של דבר אפשר להניח שפושעים ישתמשו בה. כבר ראינו שילוב של רכיבי בינה מלאכותית בהונאות קלאסיות, כמו טקסט או תמונות שנוצרו על ידי בינה מלאכותית כדי לפתות קורבנות", אומר בן גלמן, מדען נתונים בכיר, סופוס.

"עם זאת, אחת הסיבות שביצענו את המחקר, הייתה כדי לנסות ולהיות צעד אחד לפני הפושעים. על ידי יצירת מערכת ליצירת אתרים מזויפים בקנה מידה גדול, שהיא למעשה מתקדמת יותר מהכלים שבהם הפושעים משתמשים כיום, יש לנו הזדמנות ייחודית לנתח ולהתכונן לאיום לפני שהוא מתעצם", אמר גלמן.

אתר דמה שנוצר על ידי בינה מלאכותית. צילום: יח"צ סופוס

לצורך המחקר שבחן את עמדות התוקפים כלפיAI, נחקרו ארבעה פורומים בולטים ברשת האפלה שבהם מתקיימים דיונים הקשורים ל-LLM. הרושם העולה מהם הוא שהשימוש בבינה מלאכותית בקרב פושעי סייבר נמצא בשלבים ראשונים, ושחקני איומים ברשת האפלה דנים בפוטנציאל שלו. עדויות ראשונות לשימוש ב-AI מצאה סופוס בהונאות קריפטו שעשו שימוש באפליקציות היכרויות.

בנוסף מצאו חוקרי Sophos X-Ops שרוב הפוסטים היו קשורים לחשבונות ChatGPT שנפרצו ועמדו למכירה ופריצות " jailbreaks", דרכים לעקוף את ההגנות המובנות בLLM-, כך שפושעי סייבר יכולים להשתמש בהם למטרות זדוניות. חוקרי סופוס מצאו גם עשר נגזרות ChatGPT שלטענת היוצרים ניתן להשתמש בהן להפעלת התקפות סייבר ופיתוח תוכנות זדוניות. עם זאת, לשחקני איומים היו תגובות מעורבות באשר לנגזרות אלו ולאפליקציות LLMs זדוניות אחרות ורבים משחקני האיום הביעו דאגה מכך שמנסים להונות אותם.

"למרות שיש חשש משמעותי מהניצול לרעה של AI ו-LLM על ידי פושעי סייבר מאז שחרורChatGPT, המחקר שלנו מצא שעד כה, שחקני איום הם יותר סקפטיים מאשר נלהבים. בשניים מתוך ארבעת הפורומים שבדקנו ברשת האפלה, איתרנו רק 100 פוסטים על AI. בהשוואה, בדיונים על מטבעות קריפטוגרפים מצאנו 1,000 פוסטים באותה התקופה", אמר כריסטופר באד, מנהל מחקרSophos X-Ops.

"ראינו פושעי סייבר שניסו ליצור תוכנות זדוניות או כלי תקיפה באמצעות LLMs אבל התוצאות היו בסיסיות ולעתים קרובות הם נתקלו בספקנות מצד משתמשים אחרים. במקרה אחד, שחקן איום שהיה להוט להציג את הפוטנציאל של ChatGPT חשף מבלי משים מידע משמעותי על זהותו האמיתית. מצאנו גם פוסטים רבים על ההשפעות השליליות הפוטנציאליות של AI על החברה וההשלכות האתיות של השימוש בה. במילים אחרות, לפחות לעת עתה, נראה שפושעי סייבר מנהלים את אותם ויכוחים על LLM כמו כולנו", סיכם באד.

----- -----